3 تطورات مخيفة سيحققها الذكاء الاصطناعي في عام 2024

لقد كان عام 2023 هو العام الذي تغيرت فيه القواعد لصناعة الذكاء الاصطناعي، ولكنه كان مجرد البداية، إذ يؤكد الخبراء وقادة التقنية أنه سيكون أهم تقنية في عام 2024، وسيستمر في التطور بنحو أكبر في السنوات القادمة.

في أغلب الأحيان، يبدو أن الابتكارات في مجال الذكاء الاصطناعي مهيأة لتحسين أشياء، مثل: التشخيص الطبي والاكتشاف العلمي، فعلى سبيل المثال: يمكن لأحد النماذج اكتشاف هل المريض معرض لخطر الإصابة بسرطان الرئة من خلال تحليل فحص الأشعة السينية.

كما طور العلماء خلال جائحة (كوفيد-19) خوارزمية يمكنها تشخيص الفيروس من خلال الاستماع إلى الاختلافات الدقيقة في صوت سعال الأشخاص، بالإضافة إلى ذلك اُستخدم الذكاء الاصطناعي في تصميم تجارب فيزياء الكم بما يتجاوز ما تصوره البشر.

ولكن ليست الابتكارات كلها حميدة إلى هذا الحد، فمن الطائرات المسيّرة التي باتت تُستخدم في الحروب، إلى الذكاء الاصطناعي الذي يهدد مستقبل البشرية، إليك أبرز تطورات الذكاء الاصطناعي المخيفة التي من المحتمل أن تحدث في عام 2024:

1- الذكاء الاصطناعي العام (AGI):

لم تعلن شركة (OpenAI) حتى الآن السبب الحقيقي وراء إقالة رئيسها التنفيذي (سام ألتمان) من منصبه، وفصل المؤسس المشارك (جريج بروكمان) من منصبه رئيسًا لمجلس الإدارة، ثم إعادتهما إلى منصبهما في أواخر عام 2023.

ولكن وسط الفوضى التي شهدتها (OpenAI) بسبب هذه القرارات، انتشرت شائعات تشير إلى أن الشركة تعمل على نظام ذكاء اصطناعي متقدم قد يهدد البشرية، وأن قادة الشركة تنازعوا في العواقب المحتملة لهذا المشروع الجديد.

وذكرت وكالة رويترز أن نظام OpenAI الجديد هذا يحمل اسم (Q-star)، وقد يكون طفرة في بحث الشركة حول ما يُعرف باسم الذكاء العام الاصطناعي (AGI). لا يُعرف سوى القليل عن هذا النظام الغامض، ولكن إذا كانت التقارير صحيحة، فقد يؤدي ذلك إلى رفع قدرات الذكاء الاصطناعي عدة مرات خلال عام 2024.

يشير الذكاء الاصطناعي العام (AGI) إلى شكل قوي من أشكال الذكاء الاصطناعي، وهو بارع في حل المشكلات المتعددة، ويمتلك مهارات مثل مهارات الإنسان، وهناك من يقول إنه سيكون أكثر ذكاءً من الإنسان خلال مدة قصيرة.

ولكن لا تزال الأجيال الحالية من الذكاء الاصطناعي متخلفة في المجالات التي يتفوق فيها البشر، مثل: التفكير القائم على السياق والإبداع الحقيقي، فعلى سبيل المثال معظم المحتوى الذي ينشئه الذكاء الاصطناعي، إن لم يكن كله، لا يتعدى إعادة صياغة البيانات المستخدمة في تدريبه بطريقة أو بأخرى.

لكن بعض العلماء يقولون إن الذكاء الاصطناعي العام قد يؤدي وظائف معينة بشكل أفضل من معظم الناس. كما يمكن تسليحه واستخدامه، على سبيل المثال، في صناعة مسببات أمراض أكثر فتكًا، أو شن هجمات إلكترونية ضخمة، أو تنفيذ حملات تضليل واسعة النطاق.

لقد ظلت فكرة الذكاء الاصطناعي العام مقتصرة على كتب الخيال العلمي والأفلام حتى الآن، ويعتقد العديد من العلماء أننا لن نصل أبدًا إلى هذه النقطة. لذلك لو وصلت OpenAI بالفعل إلى هذه النقلة النوعية، فسيكون ذلك بمنزلة صدمة بالتأكيد، ولكنه ليس أمرًا مستبعدًا تمامًا. فنحن نعلم أن سام ألتمان كان يضع بالفعل الأساس لبناء الذكاء العام الاصطناعي في فبراير الماضي، حيث حدد نهج OpenAI تجاهه في مقال بعنوان: (التخطيط لـ AGI وما بعده)، نشره في مدونة الشركة يوم 24 من فبراير 2023.

كما نعلم أن الخبراء بدؤوا يتوقعون حدوث تطور كبير في المجال قريبًا، ومنهم: جينسن هوانغ؛ الرئيس التنفيذي لشركة إنفيديا، الذي قال في نوفمبر 2023: “إن الذكاء العام الاصطناعي سيكون في متناول أيدينا خلال السنوات الخمس المقبلة”.

Jensen Huang, CEO of NVIDIA – What is AGI? Artificial General Intelligence.

More AI at https://t.co/FBMZagp1F1 pic.twitter.com/h7auS3ukp2

— Welcome.AI (@welcomeai) January 2, 2024

فهل يمكن أن يكون عام 2024 هو عام انطلاق الذكاء العام الاصطناعي؟ الوقت وحده سيخبرنا بذلك!

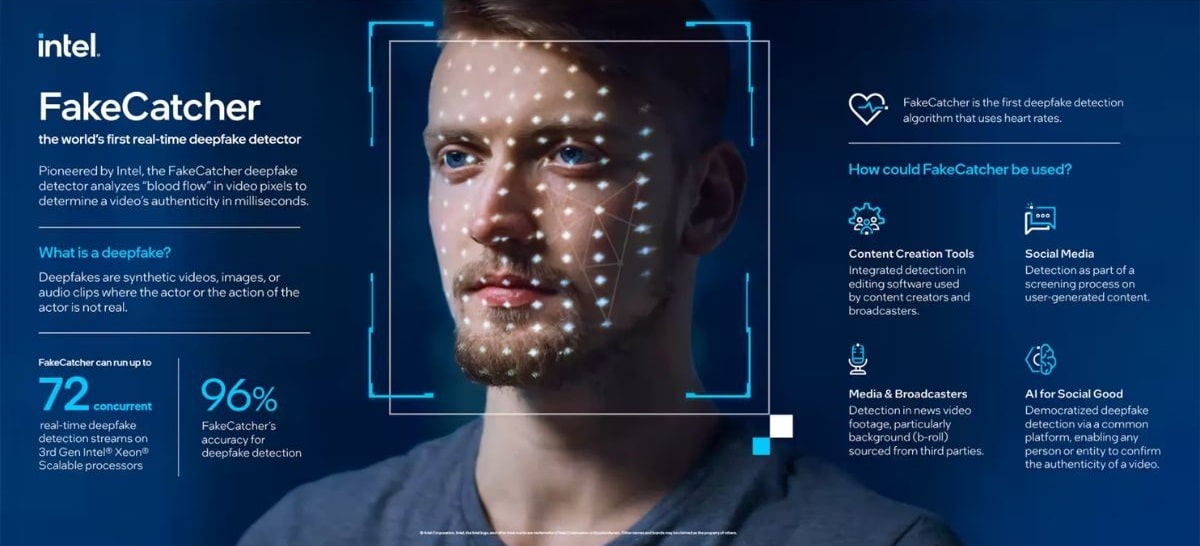

2- التزييف العميق الواقعي:

تُعد تقنية التزييف العميق (Deepfake) واحدة من التهديدات السيبرانية المُلحة في الوقت الحاضر، إذ تسهل صناعة صور أو مقاطع فيديو مزيفة بالكامل لأشخاص بهدف تشويه سمعتهم أو تجريمهم أو مضايقتهم.

لم تصل تقنيات الذكاء الاصطناعي المستخدمة في التزييف العميق بعدُ إلى مستوى يشكل تهديدًا كبيرًا حتى الآن، ولكن ذلك قد يتغير قريبًا، إذ وصل الذكاء الاصطناعي الآن إلى مرحلة تمكنه من إنشاء مقاطع فيديو مزيفة لحظيًا، أي صنع مقاطع فيديو مزيفة وبثها مباشرة، علاوة على ذلك بلغت قدرته على توليد وجوه بشرية واقعية درجةً يصعب معها على الناس التفريق بين الحقيقي والمزيف.

كما كشفت دراسة نُشرت في مجلة (Psychological Science) يوم 13 من نوفمبر 2023، عن ظاهرة (الواقعية الفائقة)، حيث من المرجح أن يُنظر إلى المحتوى الذي ينشئه الذكاء الاصطناعي على أنه حقيقي أكثر من المحتوى الحقيقي الفعلي. وهذا من شأنه أن يجعل من المستحيل عمليًا على الناس التمييز بين الحقيقة والخيال بالعين المجردة.

ومع زيادة خطورة هذه التقنية المضللة ظهرت جهود مضادة لمواجهتها، إذ تعمل شركات التكنولوجيا والحكومات على تطوير أدوات لكشف التزييف العميق بمساعدة الذكاء الاصطناعي أيضًا، فعلى سبيل المثال، طورت شركة إنتل برنامجًا يُسمى (FakeCatcher) يبحث عن أدلة حقيقية في مقاطع الفيديو من خلال تقييم ما يجعلنا بشرًا، وهو (تدفق الدم)، فعندما تضخ قلوبنا الدم، يتغير لون عروقنا، لذلك يجمع البرنامج إشارات تدفق الدم من جميع أنحاء وجه الشخص الذي يتحدث في الفيديو، وتترجم الخوارزميات هذه الإشارات إلى خرائط زمانية مكانية، ومن ثم، باستخدام التعلم العميق يمكن اكتشاف كون الفيديو حقيقيًا أم مزيفًا، ومع ذلك، لا تزال فاعليته محل نقاش.

مع تطور الذكاء الاصطناعي التوليدي، يزداد القلق من إمكانية استخدام تقنية التزييف العميق للتأثير في نتائج الانتخابات، إذ أفادت صحيفة (فايننشال تايمز) أن بنجلاديش تستعد لإجراء انتخابات خلال شهر يناير الجاري، وتستعد لأي محاولات لاستخدام التزييف العميق فيها.

ومع اقتراب انتخابات الرئاسة الأمريكية في نوفمبر 2024، يخشى الكثيرون من احتمال استخدام الذكاء الاصطناعي والتزييف العميق للتأثير في نتائج هذا التصويت الحاسم، فعلى سبيل المثال: تراقب جامعة كاليفورنيا بيركلي استخدام الذكاء الاصطناعي في الحملات الانتخابية، وأفادت قناة (NBC) أيضًا أن العديد من الولايات تفتقر إلى القوانين أو الأدوات اللازمة للتعامل مع أي زيادة مفاجئة في المعلومات المضللة الناتجة عن استخدام الذكاء الاصطناعي.

3- الروبوتات القاتلة:

تعمل الحكومات في جميع أنحاء العالم على إدماج الذكاء الاصطناعي بشكل متزايد في أدوات الحرب، إذ أعلنت الحكومة الأمريكية في 22 من نوفمبر 2023 تأييد 47 ولاية الإعلان الذي أُطلق أول مرة في فبراير 2023 بشأن الاستخدام المسؤول للذكاء الاصطناعي في الجيش.

لماذا كانت هناك حاجة إلى مثل هذا الإعلان؟ لأن الاستخدام (غير المسؤول) هو احتمال حقيقي ومرعب، إذ أشار تقرير للأمم المتحدة صدر في عام 2021 إلى أن طائرات مسيّرة تعمل بالذكاء الاصطناعي قد هاجمت أشخاصًا في ليبيا في عام 2020 دون استشارة أي بشر قبل الهجوم.

يستطيع الذكاء الاصطناعي تعرّف الأنماط، كما يمكنه التعلم ذاتيًا، وتقديم تنبؤات أو توصيات في السياقات العسكرية، وقد بدأ بالفعل سباق تسلح للذكاء الاصطناعي، ففي عام 2024، من المحتمل أننا لن نرى استخدام الذكاء الاصطناعي في أنظمة الأسلحة فحسب، بل أيضًا في الأنظمة اللوجستية، وأنظمة دعم القرار، فضلًا عن استخدامه في مجال البحث والتطوير.

فقد أنتج الذكاء الاصطناعي خلال عام 2022 ما يصل إلى 40 ألف سلاح كيميائي افتراضي جديد، وطلبت فروع مختلفة من الجيش الأمريكي طائرات مسيّرة يمكنها تعرّف الأهداف وتتبع المعارك بنحو أفضل من البشر، وتستخدم إسرائيل حاليًا الذكاء الاصطناعي لتحديد الأهداف في غزة بسرعة أكبر بمقدار 50 مرة على الأقل مما يستطيعه البشر، وفقًا لتقرير NPR.

ولكن أكثر مجالات تطوير الأسلحة رعبًا حتى الآن، هو مجال أنظمة الأسلحة الفتاكة المستقلة (LAWS)، أو ما يُعرف باسم (الروبوتات القاتلة)، وقد حذر العديد من العلماء والتقنيين البارزين – مثل: ستيفن هوكينج في عام 2015، وإيلون ماسك في عام 2017 – من مخاطر الروبوتات القاتلة التي يمكن أن تؤدي إلى قتل جماعي دون مساءلة.

لم تتحقق تكنولوجيا الروبوتات القاتلة على نطاق واسع حتى الآن، لكن تطور الذكاء الاصطناعي يثير مخاوف من إمكانية حدوث ذلك في المستقبل القريب.

ومع ذلك؛ تشير بعض التطورات المقلقة إلى إمكانية أن يكون عام 2024 هو العام الفارق لتكنولوجيا الروبوتات القاتلة، إذ أشارت بعض التقارير إلى أن روسيا نشرت في أوكرانيا طائرة مسيّرة من طراز (Zala KYB-UAV)، وهي طائرة تقول الشركة المصنعة لها إنها يمكنها تمييز الأهداف ومهاجمتها دون تدخل بشري، كما طورّت أستراليا غواصة عسكرية جديدة تُسمى (Ghost Shark) ذاتية التحكم، ومن المقرر إنتاجها على نطاق واسع.

بالإضافة إلى ذلك؛ تُعد المبالغ الضخمة التي تنفقها دول العالم على الذكاء الاصطناعي كذلك مؤشرًا مقلقًا، إذ رفعت الصين إنفاقها على الذكاء الاصطناعي من مبلغ قدره 11.6 مليون دولار في عام 2010 إلى مبلغ قدره 141 مليون دولار بحلول عام 2019، وفقًا لما ذكرته وكالة رويترز، وأضاف التقرير أن السبب في ذلك، هو أن الصين تخوض سباقًا مع الولايات المتحدة لنشر أسلحة الروبوتات القاتلة.

تشير هذه التطورات مجتمعة إلى أننا على أبواب عصر جديد، وهو عصر الحروب التي ستعتمد على الذكاء الاصطناعي.